La noticia de que IBM habría demostrado computación cuántica tolerante a fallos con un procesador de 5.000 qubits —denominado Quantum System Three— exige un análisis crítico: es un avance innegable, pero sus implicaciones prácticas requieren matices. Más allá del titular espectacular, conviene separar lo logrado técnicamente de lo que realmente significa para aplicaciones industriales, economía y seguridad a gran escala.

Avance en corrección de errores: ¿rompieron la barrera o la redefinieron?

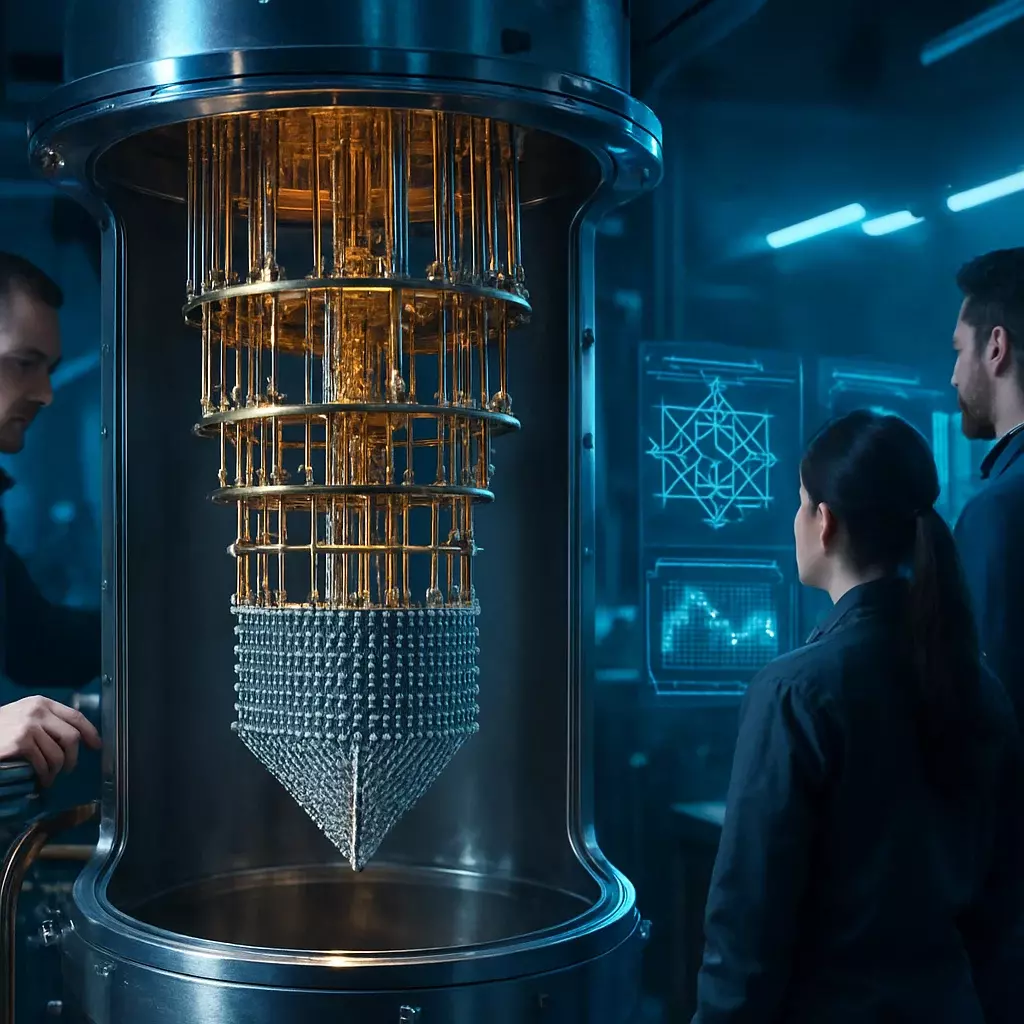

IBM atribuye el hito a un protocolo propietario de corrección de errores y a un enfoque topológico que distribuye información cuántica para resistir la decoherencia. Si los datos técnicos —fidelidades de puerta superiores al 99.9%, tiempos de coherencia de 500 microsegundos y operación con tasas de error por debajo del umbral— se mantienen en condiciones reproducibles, hablamos de una demostración relevante. Sin embargo, la prensa especializada tiende a convertir un logro experimental en una promesa inmediata de transformación social.

Enfoque topológico y supervisión predictiva

El uso combinado de codificación topológica y aprendizaje automático para anticipar y corregir errores es plausible y, de hecho, esperable en la evolución del campo. La novedad real —si se confirma— reside en la escalabilidad del esquema: codificar información resistente a fallos en miles de qubits y mantener la corrección en tiempo real. Pero la fiabilidad dependerá tanto de la robustez del algoritmo de corrección como de la uniformidad de la calidad física de los qubits; cualquier heterogeneidad en fabricación puede elevar la complejidad del control por encima de la ventaja teórica.

Limitaciones experimentales persistentes

Aunque los tiempos de coherencia y las fidelidades reportadas son impresionantes, permanecen preguntas pragmáticas: ¿con qué frecuencia requieren recalibración los sistemas? ¿Cuál es el coste energético y logístico de mantener redes de cryostatos a temperaturas cercanas al cero absoluto, aunque sean un 75% más eficientes que diseños previos? La transición de laboratorio a centros de datos comerciales implica desafíos de mantenimiento, replicabilidad y estandarización que no se solventan con un solo prototipo.

Aplicaciones prácticas: de la promesa a la implementación

Las áreas citadas —descubrimiento de fármacos, optimización financiera, materiales y modelado climático— son las más beneficiadas por simulaciones cuánticas. Casos como la aceleración en simulación molecular o la optimización de carteras son plausibles, pero conviene matizar: «aceleración» no siempre se traduce en sustitución completa de infraestructuras clásicas. Más bien, es probable que veamos soluciones híbridas donde la ventaja cuántica se aplica en subproblemas críticos dentro de pipelines dominados por cómputo clásico.

Impacto en sectores estratégicos y seguridad

La potencial ruptura de esquemas criptográficos actuales es real y exige políticas públicas proactivas. El desarrollo paralelo de criptografía resistente a la era post-cuántica es imprescindible; la ventana de transición debe cerrarse antes de que sistemas sensibles queden expuestos. Además, la concentración de capacidades cuánticas en manos de grandes corporaciones o estados plantea riesgos geopolíticos y de dependencia tecnológica que requieren regulación y cooperación internacional.

Arquitectura técnica y sostenibilidad económica

El diseño híbrido clásico-cuántico descrito facilita la integración de aceleradores cuánticos en infraestructuras existentes, reduciendo fricción operacional. No obstante, la economía de escala no es automática: la fabricación de qubits superconductores con uniformidad y la infraestructura de enfriamiento implican inversiones colosales. El reciente empujón inversor —miles de millones anunciados por actores como Microsoft y capitales de riesgo— puede impulsar la adopción, pero también alimenta expectativas que podrían chocar con límites técnicos y regulatorios.

Formación y mercado laboral

La expansión de programas académicos y la contratación de ingenieros cuánticos son lógicas. Sin embargo, la demanda formativa debe orientarse hacia competencias interdisciplinarias: control experimental, teoría cuántica, ingeniería de sistemas y software híbrido. El riesgo es un mercado con salarios inflados para habilidades todavía escasas, seguido por una fase de corrección cuando la tecnología madura y la especialización se normalice.

Perspectiva crítica: ¿ruptura inmediata o proceso evolutivo?

La narrativa de «salto definitivo» que generan titulares acompaña la lógica del marketing tecnológico: capitalizar un avance para atraer inversión. La realidad histórica de tecnologías radicales suele ser una mezcla de hitos disruptivos y largos periodos de maduración operativa. La tolerancia a fallos a escala es un umbral significativo, pero la transformación industrial completa requiere ecosistemas de hardware, software, estándares y reguladores sincronizados: eso lleva años, no meses.

Evaluar este logro exige equilibrio: celebrar la consolidación de técnicas avanzadas sin omitir la prudencia sobre plazos, costes y riesgos. El avance de IBM, si se confirma en réplicas independientes y despliegues comerciales sostenibles, redefine la hoja de ruta de la computación. Mientras tanto, investigadores, reguladores y empresas deben convertir el entusiasmo en políticas públicas, estándares técnicos y formación robusta que conviertan la promesa cuántica en beneficio real y responsable para la sociedad.